潮人地东莞seo博客小编下面跟大家分享关于等问题,希望seo专员在做seo优化的过程中有所帮助,内容仅供参考。

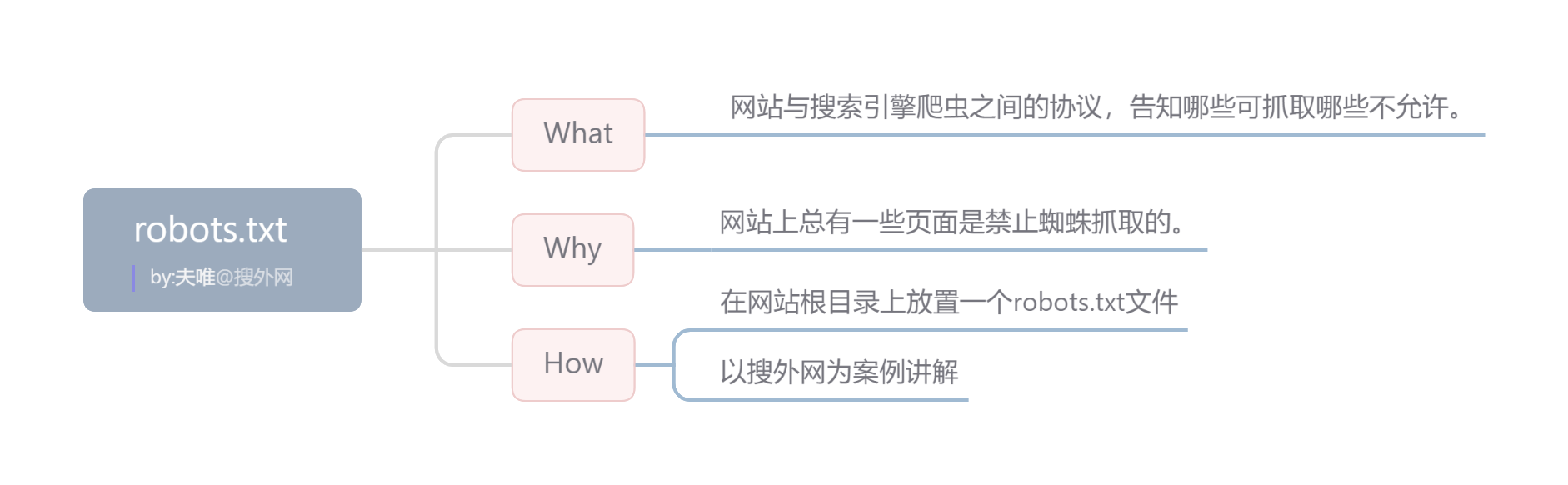

| 什么是robots文件?

Robots是站点与spider沟通的重要渠道,是网站与搜索引擎爬虫之间的协议,告知哪些可抓取哪些不允许。

seo博客相关推荐阅读:seo优化博客:网站优化seo是怎样,为怎样要学这门技术

| 为什么要做robots文件?

网站上总有一些页面是禁止蜘蛛抓取的。例如:搜索页面、筛选页面、后台登录地址等。

| 如何制作 robots文件?

编吉林完善seo优化方法写robots.txt文件并上传到网站根目录。

| 制作 robots.txt注意事项

● 所有搜索引擎则用星号表示

● Allow(允许)和Disallow(不允许)优先级

● 至少屏蔽一个,可以屏蔽:搜索结果页面/404页面

● 记得将sitemap放到Robots文件中

● 可以陆续放入更多,而不是一次性决定所有

● 网站后台地址/图片地址/下载文件地址/错误链接

本文的视频课程地址:https://ke.seowhy.com/play/9492.html

阅读本文的人还可以阅读:

什么是robots文件?设置搜索robots协议的后果seo优化常用方法推广排名

robots.txt文件用法举例,百度官方资料截图版

robots.txt概念和10条注意事项

Robots.txt 文件应放在哪里?

如何使用Robots避免蜘蛛黑洞?

以上是潮人地东莞seo博客跟大家分享关于百度seo优化排名:robots.txt:如何让搜索引擎不要抓取没用的页面等问题,希望能对大家有所帮助,若有不足之处,请谅解,我们大家可以一起讨论关于网站seo优化排名的技巧,一起学习,以上内容仅供参考。